前言

机器学习和人工智能,一直觉得挺神秘而且又高大上的,经常听说,但又因为各种数学概念而没有付诸实践。

但是,如果不做专职的相关岗位开发,自己跑一些学习程序是否可行呢?比较现在各种框架都挺多的了,即使再不济,了解一下具体都能做哪些东西也是很不错的。

入手了周志华的《人工智能》一书,刚看了开头,觉得讲的非常好。以例子开始逐步深入,做了如下笔记。

一、以普通例子循序渐进讲解什么是机器学习

以挑西瓜的例子开篇: 为什么色泽青绿、根蒂蜷缩、敲声浊晌,就能判断出是正熟的好瓜?

因为我们吃过、看过很多西瓜,所以基于色泽、根蒂、敲声这几个特征我们就可以做出相当好的判断。

过渡,引出学习经验:类似的,我们从以往的学习经验知道,下足了工夫、弄清了概念、做好了作业,自然会取得好成绩。可以看出,我们能做出有效的预判?是因为我们已经积累了许多经验,而通过对经验的利用?就能对新情况做出有效的决策。

进而来说机器学习:如果说计算机科学是研究关于"算法"的学问,那么类似的,可以说机器学习是研究关于"学习算法"的学问。

二、通过西瓜的例子类比学习一些相关术语

1. 以数据表格方式学习

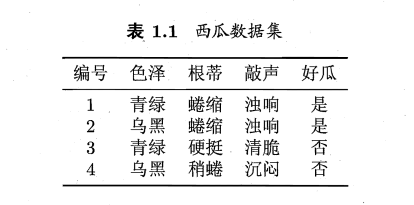

将西瓜的例子归纳为下面的表格:

| 序号 | 色泽 | 根蒂 | 敲声 |

|---|---|---|---|

| 1 | 青绿 | 蜷缩 | 浊响 |

| 2 | 乌黑 | 稍蜷 | 沉闷 |

| ...... |

对照表格,了解一些相关术语:

- 数据集:整个表格的记录集合。

- 示例 (instance) 或样本 (sample):每条记录是关于一个事件或对象(这里是一个西瓜)的描述,称为一个示例 (instance) 或样本 (sample)。有时整个数据集亦称一个"样本"因为它可看作对样本空间的一个采样,通过上下文可判断出"样本"是指单个示例还是数据集。

- 属性 (attribute) 或特征(feature):表格中的“色泽”、“根蒂”、“敲声”。

- 属性值 (attribute va1ue):表格中的“色泽”、“根蒂”、“敲声”对应的值。

2. 还记得坐标系么

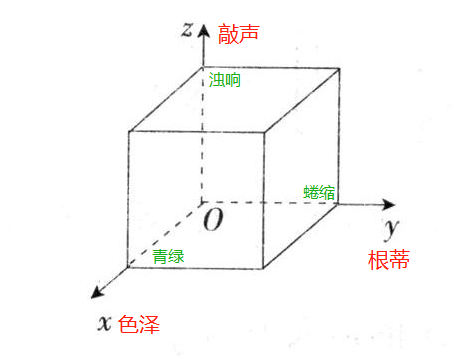

对于单条记录,以“色泽”、“根蒂”、“敲声”三个属性标识如下图:

每个属性作为一个坐标轴,就形成了一个三维的坐标系。 坐标系还记得吧,希望还没全还给老师。

属性张成的空间称为"属性空间" (attribute space) "样本空间" (sample space) 或"输入空间",即图中的长方体。

当然,实际上一个样本(西瓜)肯定不止这三个属性,这里只是举例。每个属性代表一个坐标轴,那就会组成一个d维空间,d为样本的属性数。

每个西瓜都可在这个空间中找到自己的坐标位置。由于空间中的每个点对应一个坐标向量,因此我们也把…个示例称为一个"特征向量" (feature vector)。

3. 训练相关的一些术语

从数据中学得模型的过程称为"学习" (learning) 或"训练" (training);

这个过程通过执行某个学习算法来完成.训练过程中使用的数据称为"训练数据" (training data) ;

其中每个样本称为一个训练样本" (training sample),;

训练样本组成的集合称为"训练集" (training set).

学得模型对应了关于数据的某种潜在的规律,因此亦称"假设" (hypothesis);

这种潜在规律自身,则称为"真相"或"真实" (ground-truth) ;

学习过程就是为了找出或逼近真相.本书有时将模型称为"学习器" (learner) ,可看作学习算法在给定数据和参数空间上的实例化.

训练不止需要样本的属性信息,还需要样本的"结果"信息,例如" ((色泽:青绿;根蒂二蜷缩;敲声=浊响),好瓜)" .这里关于示例结果的信息,例如"好瓜",称为标记 (labe1);

拥有了标记信息的示例,则称为"样例" (example)。如下图

若我们欲预测的是离散值,例如"好瓜" "坏瓜",此类学习任务称为"分类" (classification);

若欲预测的是连续值?例如西瓜成熟度 0.95 0.37,此类学习任务称为"回归" (regression).

对只涉及两个类别的"二分类" (binary classification) 任务,通常称其中一个类为正类(positive class),另一个类为"反类" (negative class);

涉及多个类别时,则称为"多分类" (multi-class classificatio)任务。

学得模型适用于新样本的能力,称为"泛化" (generalization) 能力.具有强泛化能力的模型能很好地适用于整个样本空间.

三、假设空间

在数学公理系镜中,基于一组公理和推理规则推导出与之相洽的定理,这是演绎;而"从样例中学习"显然是一个归纳的过程,因此亦称"归纳学习" (inductive learning) .。

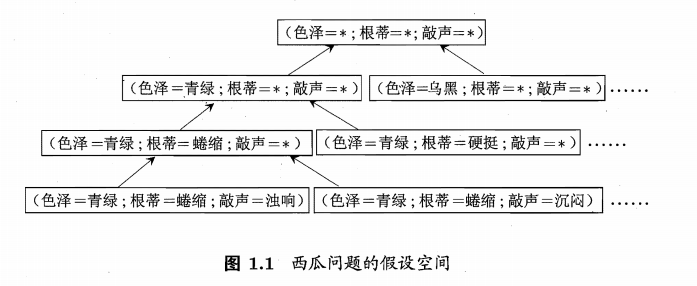

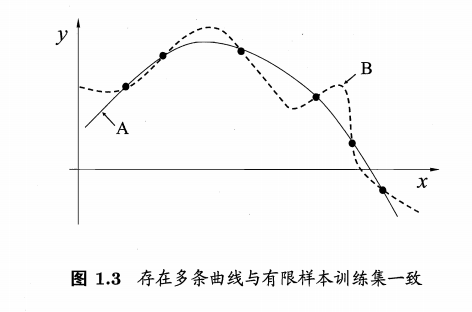

我们可以把学习过程看作一个在所有假设(hypothesis) 组成的空间中进行搜索的过程。如下图

有多少种可能呢,就是一个排列组合。现实问题中我们常面临很大的假设空间,但学习过程是基于有限样本训练集进行的,因此,可能有多个假设与训练集一致,即存在着一个与训练集一致的"假设集合",我们称之为"版本空间" (version space)。

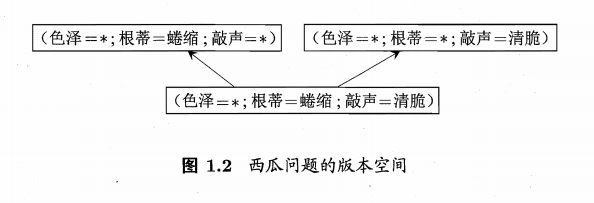

四、归纳偏好

对于图1.2的西瓜版本空间,对应(色泽口=青绿;根蒂=蜷缩;敲声=沉闷)这个新收来的瓜,如果我们采用的是"好瓜<->(色泽= )^(根蒂=蜷缩)^(敲声=),那么将会把新瓜判断为好瓜,而如果采用了另外两个假设,则判断的结果将不是好瓜。若仅有表1. 中的训练样本,则无法断定上述三个假设中明哪一个"更好, 那么计算机就傻了。

怎么办,任何一个有效的机器学习算法必有其归纳偏好,否则它将被假设空间中看似在训练集上"等效"的假设所迷惑,而无法产生确定的学习结果。

那么,有没有一般性的原则来引导算法确立"正确的"偏好呢? "奥卡姆剃刀" (Occam's razor) 是一种常用的、自然科学研究中最基本的原则,即"若有多个假设与观察一致,则选最简单的那个。

总结

脱离具体问题,空泛地谈论"什么学习算法更好"毫无意义,因为若考虑所有潜在的问题,则所有学习算法都一样好。要谈论算法的相对优劣,必须要针对具体的学习问题;在某些问题上表现好的学习算法,在另一些问题上却可能不尽如人意,学习算法自身的归纳偏好与问题是否相配,往往会起到决定性的作用。